随着人工智能技术在各行各业的深度融合与广泛应用,其带来的效率革命与创新机遇有目共睹。算法偏见、数据隐私泄露、系统被恶意利用等安全风险也随之凸显,对个人权益、社会公平乃至国家安全构成了新的挑战。因此,构建一个安全、可信、负责任的人工智能生态系统,已成为全球共识。这一目标的实现,离不开两大支柱的协同并进:顶层设计的“人工智能安全政策与标准”与落地实践的“人工智能应用软件开发”。二者如同车之双轮、鸟之两翼,共同驱动着人工智能产业向着健康、可持续的方向发展。

一、 人工智能安全政策与标准:划定发展的安全边界与伦理红线

人工智能安全政策与标准是确保技术发展不偏离正确轨道的“导航系统”和“交通规则”。它们从宏观层面为人工智能的研发、部署与应用划定安全边界与伦理红线。

- 政策引领方向:世界主要国家和地区纷纷出台人工智能发展战略与治理框架。例如,欧盟的《人工智能法案》旨在基于风险等级对AI系统进行规制,严格禁止某些高风险应用;中国的《新一代人工智能治理原则》强调发展负责任的人工智能,倡导“和谐友好、公平公正、包容共享、尊重隐私、安全可控、共担责任、开放协作、敏捷治理”等原则。这些政策文件明确了发展价值观,强调了安全可控、隐私保护、公平非歧视等核心要求,为产业界提供了清晰的合规指引。

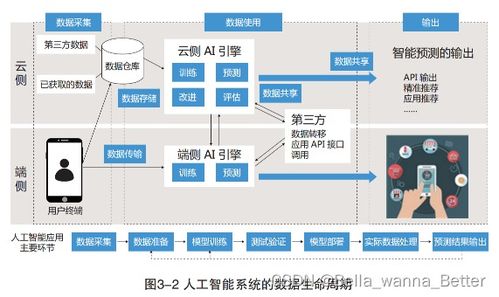

- 标准提供抓手:政策的原则性要求需要通过具体的技术与管理标准来落地。国际标准化组织(ISO)、国际电工委员会(IEC)以及各国的标准机构正在加紧制定人工智能安全、可信赖性、数据治理等方面的标准。这些标准涵盖了从数据采集、模型训练、算法评估到系统部署、运行监控的全生命周期,为开发者和企业提供了可操作、可评估的技术规范。例如,关于算法公平性的评估标准、隐私保护计算的技术标准、AI系统安全测试的指南等,都是将安全伦理要求“编码”入开发流程的关键工具。

二、 人工智能应用软件开发:将安全与可信内化于技术实践

再好的政策与标准,最终需要在具体的软件开发过程中得到贯彻。人工智能应用软件的开发者是构建安全防线的第一责任人,必须在软件开发生命周期(SDLC)的每个环节嵌入安全与可信的考量。

- “安全左移”与“设计即安全”:传统的安全措施往往在开发后期才介入,对于AI系统而言为时已晚。现代安全实践强调“安全左移”,即在需求分析、架构设计阶段就充分考虑安全与隐私需求。这意味着在设计算法模型时,就要评估其可能带来的偏见、可解释性不足等风险;在设计数据管道时,就要融入数据脱敏、加密和最小权限原则。

- 全生命周期安全管理:

- 数据阶段:确保训练数据的代表性、质量以及来源的合法性,实施严格的数据访问控制和隐私保护技术(如差分隐私、联邦学习)。

- 模型开发阶段:进行持续的公平性测试和偏见检测,提升模型的可解释性,对模型进行对抗性样本鲁棒性训练。

- 部署与运维阶段:建立模型的持续监控机制,能够检测模型性能衰减、输入数据漂移以及潜在的恶意攻击;制定明确的应急预案和模型回滚机制。

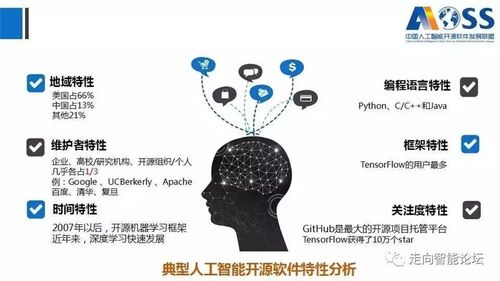

- 供应链安全:关注所使用的开源框架、预训练模型、第三方API的安全性,管理好软件物料清单(SBOM)。

- 工具与文化赋能:开发者需要借助自动化的安全测试工具、公平性评估工具包、漏洞扫描工具等来提升效率。在企业内部培育“安全与可信”的文化至关重要,通过培训让每一位工程师都理解其重要性,并落实到日常代码编写和系统设计中。

三、 政策标准与软件开发的协同闭环

政策、标准与软件开发并非孤立的环节,而是构成了一个动态增强的协同闭环:

- 政策驱动标准与开发:宏观政策指明风险领域和治理重点,催生具体的技术与管理标准。这些标准又直接引导和约束软件开发实践,例如要求软件必须通过特定的安全认证或符合某类公平性指标。

- 开发实践反馈与完善标准:在软件开发与落地应用中遇到的新问题、新挑战(如新型对抗攻击、复杂的多模态伦理困境),会反过来为标准的修订和政策的完善提供实践依据,推动治理框架与时俱进。

- 技术赋能治理:人工智能技术本身也可以用于赋能安全治理,例如利用AI进行自动化合规检查、监测网络空间中的恶意AI应用、分析算法偏见等,形成“以AI治理AI”的良性循环。

结论

人工智能的安全与可信是一项系统性工程。坚实的“人工智能安全政策与标准”为整个行业树立了清晰的规则和期望,而负责任、有意识的“人工智能应用软件开发”则是将这些规则转化为安全产品与服务的关键过程。只有两者紧密结合,让合规要求深度融入技术血脉,让开发实践不断反馈优化规则,我们才能有效驾驭人工智能这把“双刃剑”,在享受其巨大红利的牢牢守住安全的底线,最终实现科技向善,造福人类社会。